dLLM-модель — она уделывает обычные LLM-модели и генерирует текст в 5-10 раз быстрее

Вышла первая dLLM-модель — она уделывает обычные LLM-модели и генерирует текст в 5-10 раз быстрее

Работает на основе диффузии, как генераторы изображений. Что это значит:

• Токены генерируются не поочерёдно как в LLM, а сразу все, и только потом расставляются в правильном порядке

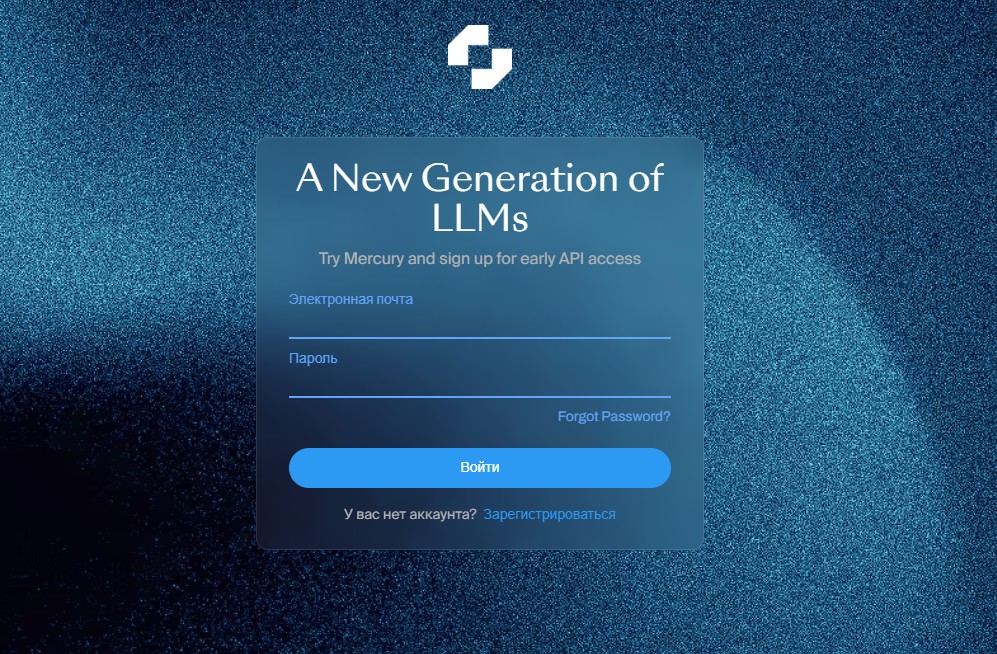

• Первая dLLM-модель называется Mercury Coder от Inception — кодит на уровне GPT-4o, но НАМНОГО быстрее

• Технология может ускорить классические модели — объёмные тексты будем получать В МИГ

Потестить бесплатно можно тут